Эпоха искусственного интеллекта принесла много положительного, облегчив работу и увеличив производительность миллионов людей по всему миру. Тем не менее, вместе с ней пришли и новые проблемы — в том числе и в гендерных вопросах. Женщины столкнулись с новой волной неравенства, выраженного в создании сексуализированного контента, насилия, социального давления и дисбаланса в вопросах здоровья и финансов. Рассказываем, что к этому привело, как бигтех и государство реагируют на проблему, и почему ИИ остаётся настолько мизогинным.

xAI

Во второй половине 2025 года в X, бывшем Twitter, сильно завирусился промпт для встроенной в социальную сеть модели xAI — Grok. Пользователи публиковали фотографии (часто свои, но ещё чаще чужие) и писали короткий запрос: «Grok, put me in a bikini». Модель без лишних вопросов редактировала приложенные изображения, выдавая на выходе полуэротическую фотографию. Хотя в рекомендательных лентах большинства пользователей тренд имел скорее юмористическую направленность, а в бикини изображались часто и популярные мужчины вроде Дональда Трампа, Криштиану Роналду или самого Илона Маска, проблема быстро стала очевидной.

Генерация сексуализированного контента в некотором смысле неизбежна, всегда будут находиться люди, которые смогут использовать технологии в подобных целях. Однако такой массовости, которую создание эротических материалов достигло в X с помощью встроенного Grok, ожидать было трудно.

В пределах социальной сети было много критики с обеих сторон. Часть сообщества критиковала техническую возможность генерации эротики с феминистских позиций, часть (что удивительно) критики сыпалась справа — преимущественно в мотивах традиционных ценностей и вреда сексуализированного контента для потребителя, а не для жертвы созданных фейков.

Тем не менее, реакцию общественности сложно назвать незамедлительной. Первые материалы в медиа на эту тему стали появляться только в середине января, когда массовое помешательство на генерации уже прошло стадию только эротического контента. К нему быстро добавились сгенерированные изображения со следами насилия: на изображения добавляли кровь и следы от пуль.

Прежде чем владельцы X отреагировали на происходящее, пользователи сгенерировали 23 тысячи сексуализированных изображений детей — среди них, например, одна из актрис сериала «Очень странные дела». В целом, на протяжении двух недель Grok генерировал около 190 сексуализированных изображений в минуту, что в сумме даёт более трёх миллионов.

Один из примеров использования промпта «put her in a bikini».

Реальность угрозы

Grok — не единственная ИИ-модель, способная генерировать сексуализированный контент. Исследования показывали, что только среди публично доступных приложений, которые можно скачать в AppStore и Google Play, было около сотни моделей. К началу 2026 года их суммарно скачали более 700 миллионов раз (с учётом повторных скачиваний), а их выручка составила около 117 миллионов долларов.

В поляризованном интернет-пространстве жертвами сексуализированной генерации быстро становятся популярные женщины. Например, Александрия Окасио-Кортес, одна из сегодняшних лидеров Демократической партии США — атаки с использованием моделей против неё связывают не только с личной неприязнью, но и политическими и расистскими мотивами. То же верно для Зендаи, для Cardi B и многих других — их изображали не только в сексуализированных нарядах, но и с подчёркнуто белой кожей.

Многим из нас кажется, что мы живём в мире, где все быстро адаптировались к угрозе искусственного интеллекта и научились отличать зёрна от плевел и фейки от правды. На деле всё оказывается сложнее. Фейки несут большую опасность, поскольку не все способны отличить их от реальных фотографий или видеозаписей. Тем не менее, даже в случаях, когда все всё понимают, буллинг и виктимблейминг не исключены.

Уже сейчас есть множество задокументированных случаев, когда девочки бросали учёбу в школе из-за буллинга после публикации сексуализированных фейков, часть жертв страдают ПТСР, который будет влиять на них всю дальнейшую жизнь. Психологическое насилие в этом смысле огромно, оно создаёт давление на тех, кто и без него не был сильно успешен в своём социальном окружении.

Угроза нередко переходит масштаб исключительно психологического и социального давления. В частности, некоторые женщины сталкивались с угрозами так называемых «убийств чести» в связи с появлением сексуализированных дипфейк-видео с их участием. Это особенно актуально для Ближнего Востока и части других регионов в мире, где существует контроль за сексуальным поведением женщины как представительницы определённого рода, религиозной или этнической группы.

Пример сгенерированного изображения с Илоном Маском. Оно широко разошлось в X.

Неизбежность

Причины, по которым ИИ имеет больший отрицательный эффект на женщин, чем на мужчин, на деле довольно просты. Участие женщин в создании моделей искусственного интеллекта довольно ограничено на каждом этапе. Среди инженеров и дизайнеров, отвечающих непосредственно за разработку таких продуктов, женщины не превышают 12% участников. Это ничтожно малый показатель не только при соотнесении с пропорциями в населении в целом, он мал даже для гендерного распределения в IT-индустрии.

Есть исследования, показывающие, что доля женщин достигает 22%, но на руководящих позициях она падает до 14%. Цифры в любом случае крайне малы. Показатели финансирования удручают ещё больше: женщины получают около 2% венчурного капитала, но всё, опять же, зависит от методологии подсчёта. Если взять команды, которые имеют хотя бы одну женщину, то показатель поднимается до 23%, и это всё ещё шокирующе мало. Исключительно женские составы учредителей, где нет мужчин-сооснователей, получали около 1% инвестиций в индустрию.

Такой гендерный дисбаланс неизбежно означает, что подход к формированию ИИ-продуктов, какими мы их знаем на выходе, будет включать в себя часть гендерных стереотипов. Это легко подтверждается результатами взаимодействия женщин с генеративным искусственным интеллектом. Есть задокументированные случаи, когда он советовал женщинам запрашивать более низкую зарплату относительно аналогичных промптов для мужчин при вопросах о поиске работы.

Что касается вопросов женского здоровья, то и здесь всё складывается иначе. Очевидно, что мужской и женский организмы отличаются, вероятность возникновения проблем при идентичных состояниях может сильно варьироваться. Исследования показывают, что ИИ-модели чаще пропускали, например, заболевание печени у женщин, чем у мужчин, причём разрыв колоссальный — неверное диагностирование встречалось вдвое чаще.

Вывод из этого прост: недостаточная представленность женщин в создании ИИ-продуктов приводит к проблемам взаимодействия между ними. Как пишет известная феминистка Лора Бейтс, «мы не те, кто строит этот мир, но мы вынуждены жить в нём без выбора».

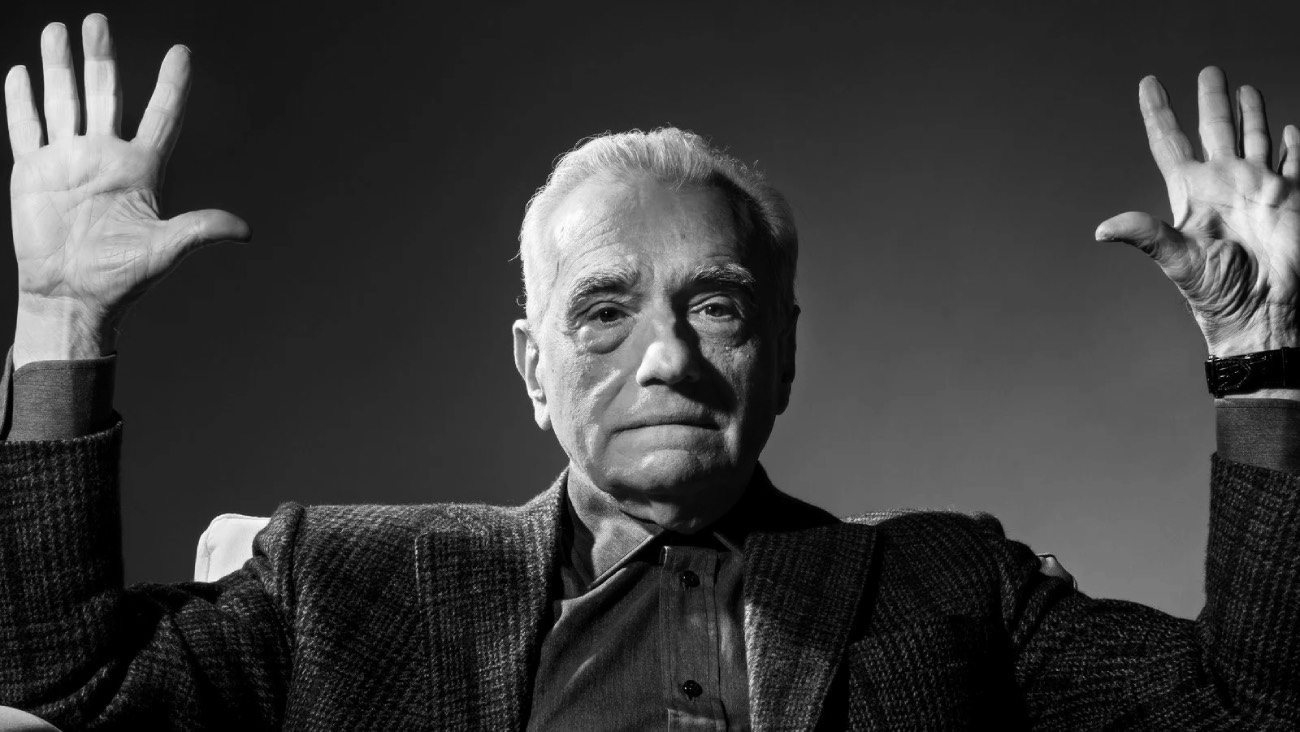

Лора Бейтс, британская феминистка и одна из наиболее активных противниц использования ИИ в целях объективизации женщин. Фото с официального сайта.

Что делать?

В вопросах гендерного равенства нельзя рассчитывать на технологических гигантов. Описанный выше пример с генерацией сексуализированного контента в Grok демонстрирует, что бигтех реагирует только при наличии давления. Например, xAI не убрала возможность непозволительной генерации даже после появления критики. Она просто сделала эту функцию платной, фактически монетизировав злоупотребление вместо того, чтобы пресечь его.

Это происходит не потому что xAI является какой-то особенно неэтичной компанией. Такие примеры есть и у Meta: после резкого сокращения цензуры в 2025 году внутренние документы позволяли чат-ботам вести романтические разговоры с детьми и подростками. Его исправили лишь тогда, когда в дело вмешались Reuters — крупнейшее информационное агентство мира. Что было бы, если бы журналистам в руки не попали документы? Вопрос, конечно, риторический.

Государства реагируют на проблемы лучше, поскольку регуляция — это их основная деятельность. В июне прошлого года, например, Великобритания криминализировала создание сексуализированных дипфейков без согласия, но даже к моменту скандала с генерацией в Grok нормы ещё оставались не вступившими в силу и не могли быть использованы для судов.

Проблема государственной регуляции состоит в том, что она носит преимущественно реактивный характер — нормативно-правовые акты возникают только тогда, когда проблемы уже существуют. Государственная регуляция для предотвращения подобных проблем должна смениться на превентивную, когда для каждого значимого ИИ-продукта до выхода на рынок будет проводиться аудит инструментов генерации и появятся стандарты так называемой «безопасности по умолчанию». Для того, чтобы эпоха ИИ стала обещанным светлым будущим без гендерного дисбаланса и преманентной мизогинной угрозы, необходимы защитные механизмы до возникновения проблем.